La concorrenza dei processi si riferisce alla capacità di un sistema operativo di gestire più processi che sembrano eseguire simultaneamente. In un sistema operativo multitasking, più processi sono attivi nello stesso periodo, e la gestione concorrente dei processi è essenziale per sfruttare al meglio le risorse di calcolo, in particolare la CPU.

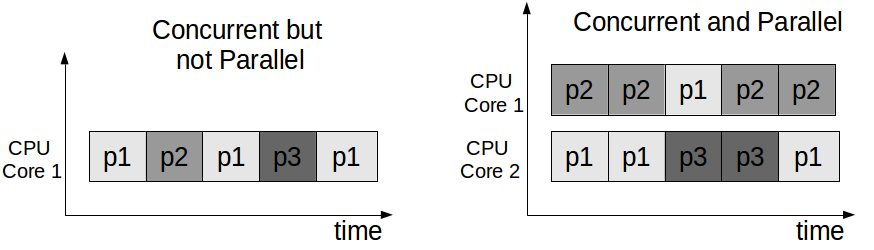

Anche se su una CPU a singolo core solo un processo alla volta può essere eseguito fisicamente, il sistema operativo può alternare tra i processi in esecuzione così rapidamente da dare l’illusione della simultaneità. In un sistema multicore, più processi possono effettivamente essere eseguiti contemporaneamente, ognuno su un core diverso.

Caratteristiche della concorrenza dei processi

- Multitasking: è l’esecuzione di più processi apparentemente nello stesso momento. Il sistema operativo usa tecniche come la commutazione di contesto (context switching) per alternare tra processi, allocando brevi intervalli di tempo a ciascuno. Questo fa sembrare che i processi siano eseguiti simultaneamente.

- Multithreading: un processo può essere suddiviso in più thread. I thread sono entità più leggere rispetto ai processi e possono condividere risorse, come la memoria, con il processo principale. I thread possono essere eseguiti in modo concorrente per migliorare l’efficienza.

- Condivisione delle risorse: i processi concorrenti spesso devono condividere risorse del sistema, come file, stampanti o dati in memoria. La gestione efficace della concorrenza include l’accesso sicuro e controllato a queste risorse per evitare conflitti.

- Interleaving: nei sistemi monoprocessore, i processi vengono eseguiti in modo intercalato (interleaved), dove la CPU alterna rapidamente tra più processi attivi. Questo scambio avviene spesso così rapidamente che l’utente non nota interruzioni.

- Esecuzione parallela: su sistemi multiprocessore o multicore, la concorrenza si può realizzare anche a livello hardware, dove più processi o thread vengono eseguiti contemporaneamente su diversi core.

Problemi legati alla concorrenza

La concorrenza comporta sfide complesse. Ecco alcune delle principali problematiche che sorgono durante la gestione della concorrenza tra processi:

- Race Condition (Condizione di competizione):

- Si verifica quando due o più processi o thread tentano di accedere contemporaneamente e in modo non sincronizzato a risorse condivise, come variabili o file. L’ordine delle esecuzioni può influenzare il risultato finale, portando a comportamenti indesiderati.

- Ad esempio, se due thread tentano di modificare una variabile contemporaneamente, il risultato finale dipende dall’ordine delle operazioni.

- Deadlock (Blocco reciproco):

- Il deadlock si verifica quando due o più processi rimangono bloccati in attesa di risorse che sono detenute l’uno dall’altro. Nessuno dei processi è in grado di procedere perché ognuno sta aspettando che l’altro liberi una risorsa.

- Esempio: Processo A ha una risorsa di cui il processo B ha bisogno, e viceversa, creando un circolo vizioso in cui nessuno dei due processi può progredire.

- Starvation (Inanizione):

- Si verifica quando un processo non riceve mai risorse sufficienti per progredire a causa di una gestione iniqua della concorrenza. Un processo potrebbe essere continuamente “bypassato” da altri processi con priorità più alta, lasciandolo in attesa indefinitamente.

- Livelock:

- Simile al deadlock, ma invece di essere completamente bloccati, i processi coinvolti continuano a cambiare stato senza fare progressi reali. In questo caso, i processi non sono fermi, ma non riescono comunque a raggiungere un obiettivo.

Meccanismi per gestire la concorrenza

Esistono diversi meccanismi per gestire la concorrenza dei processi e garantire che le risorse condivise siano utilizzate in modo sicuro ed efficiente. Questi includono:

- Mutua esclusione (Mutex):

- La mutua esclusione è un principio che assicura che solo un processo o thread alla volta possa accedere a una risorsa critica, come una variabile condivisa o un file.

- I mutex (o semafori binari) sono oggetti utilizzati per implementare la mutua esclusione. Un processo deve acquisire il mutex prima di accedere alla risorsa e lo rilascia una volta completato l’uso della risorsa.

- Semafori:

- I semafori sono variabili che possono essere utilizzate per controllare l’accesso a più risorse condivise. Sono utilizzati per sincronizzare l’esecuzione di più processi o thread. I semafori possono essere binari (solo due stati: acquisito o libero) o contatori (permettono l’accesso simultaneo fino a un certo numero di processi).

- Monitor:

- I monitor sono una forma avanzata di sincronizzazione che consente di gestire l’accesso a variabili e risorse condivise tra processi o thread. Un monitor è un’astrazione che include sia dati condivisi sia le funzioni che gestiscono quei dati in modo sicuro.

- Barriere di sincronizzazione:

- Una barriera è un meccanismo che impedisce ai processi di proseguire fino a quando tutti i processi coinvolti non hanno raggiunto un determinato punto. È utile quando è necessario che i processi o thread eseguano una certa operazione in sincronia.

- Algoritmi di prevenzione e rilevamento del deadlock:

- Per evitare il deadlock, i sistemi operativi possono implementare tecniche di prevenzione (come l’allocazione anticipata delle risorse o l’uso di risorse in ordine gerarchico). Inoltre, possono implementare algoritmi per rilevare situazioni di deadlock e risolverle forzando la terminazione di alcuni processi.

Esempi di utilizzo della concorrenza

- Sistemi operativi multitasking: Windows, Linux, e macOS sono esempi di sistemi operativi che implementano la concorrenza per eseguire più programmi contemporaneamente.

- Applicazioni multithread: molte applicazioni moderne (come browser web, videogiochi, e software di elaborazione dati) utilizzano più thread per migliorare le prestazioni, eseguendo operazioni in parallelo.

- Elaborazione parallela: i sistemi di calcolo parallelo (supercomputer, cluster di calcolo) eseguono compiti complessi suddividendo il lavoro in più processi o thread che operano contemporaneamente.

In sintesi:

La concorrenza dei processi è una caratteristica fondamentale dei sistemi operativi moderni, che consente di eseguire più processi simultaneamente, sfruttando al meglio le risorse del sistema. La gestione efficace della concorrenza comporta l’uso di tecniche per evitare problemi come il deadlock, la race condition, e la starvation, attraverso meccanismi di sincronizzazione come mutex, semafori e monitor, che garantiscono un accesso sicuro e ordinato alle risorse condivise.